۹۲/۰۷/۲۰

این جلسه باقی K-means را می گوییم و در جلسه بعدی درس بعدی GMM هست

در تمرین ها

توضیح معیار را از مقاله کپی نکنید ( به صورت انگلیسی )

برداشت خودتان را به فارسی بنویسید

در LMS بفرستید

و اگر نتونسید به ایمیل clustering_1391@yahoo.com

تا روز جمعه بفرستید

محدودیت اصلی روش k-means مبنایی

چنانچه مقادیر اولیه بردار های میانگین خوشه درست و مناسب انتخاب نشود.

ممکن است J در مینیمم محلی متوقف شود.

۳ روش برای مقدار دهی اولیه الگوریتم خوشه بندی K میانگین

۱- تصادفی

۲- تقسیم باینری

۳- آماده سازی حساس به هیستوگرام

روش آماده سازی رندوم : Random Selection

در این روش الگوریتم خوشه بندی k میانگین چندین بار با مراکز اولیه رندوم اجرا شده ، مراکزی که اولین مقدار تابع هدف اعوجاج به عنوان مراکز اولیه الگوریتم خوشه بندی در نظر گرفته می شوند.

روش تقسیم باینری :Binary Splitting

۱- از کل بردار ها یک مقدار متوسط و یک مقدار انحراف استاندارد می گیرد

۲- از مقدار متوسط یک ضریبی از انحراف استاندارد مقدار با کم و به اندازه همان زیاد می کند

۳- هر خوشه را بر اساس متوسط و انحراف استاندارد به دو گروه دیگر تقسیم می کند

درنهایت به k مرکز میرسیم

مثلا به ۷ تا خوشه که رسیدیم خوشه ها را ۸ تا در نظر میگیریم

این روش نسبت به روش رندوم سریعتر و موفق تر هست

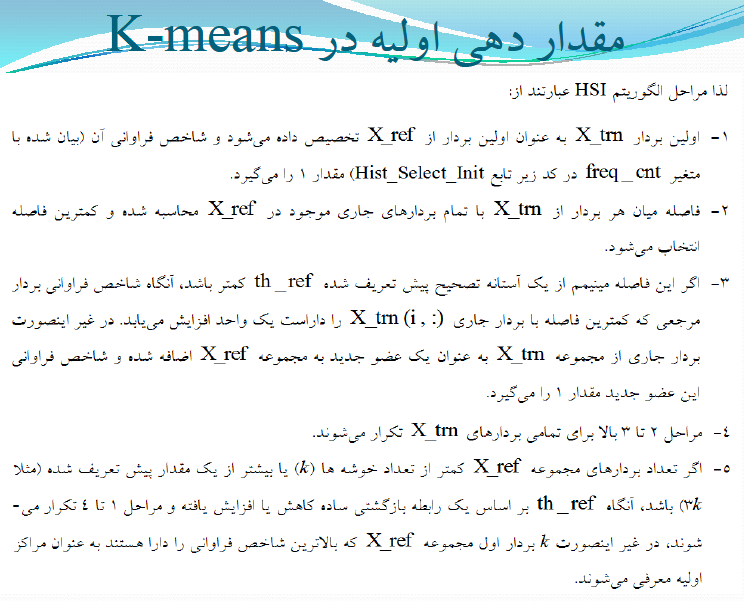

روش حساس به هیستوگرام Histogram Sensitive

این روش یک هیستوگرام را بدست می آورد( نمودار فراوانی داده ها ) Hist در متلب را تست کنید.

مجموعه اول خالی هست

روش کار در اسلاید

اولی بردار از مجموعه یادگیری را در مجموعه رفرنس قرار می دهیم

یک شاخص فراوانی داریم که به هر خوشه یک بردار نسبت میدهد

اگر فاصله از یک آستانه کمتر بود بردار دوم را بیرون می اندازیم و تعداد فراوانی که در آستانه بود را ۲ می کنیم

نمونه سوم را فاصله اش را با این یک نمونه پیدا می کنیم

نمونه سوم را حذف نمی کنیم بلکه به عنوان نمونه جدید در X_ref می گذاریم

مقایسه می کنیم ، با هر کدام که کمترین بود

پس سه روش K-means

RSI

BSI

HSI

هست

قلب الگوریتم خوشه بندی تابع هدف آن است.

سوال : در توزیع نرمال اینکه بردار داریم در این صورت توزیع نرمال چطور محاسبه می شود؟ منظورم در قسمت ایکس منهای میو است